Компания OpenAI ввела строгие ограничения на использование ChatGPT в чувствительных сферах: медицине, юриспруденции, психологии, финансах, страховании и образовании. Теперь чат-бот не будет давать персонализированных советов, интерпретировать медицинские анализы, снимки или фотографии тела, а также предлагать диагнозы, лечение или терапию — всё это требует лицензированного специалиста, и ИИ больше не берёт на себя такую ответственность.

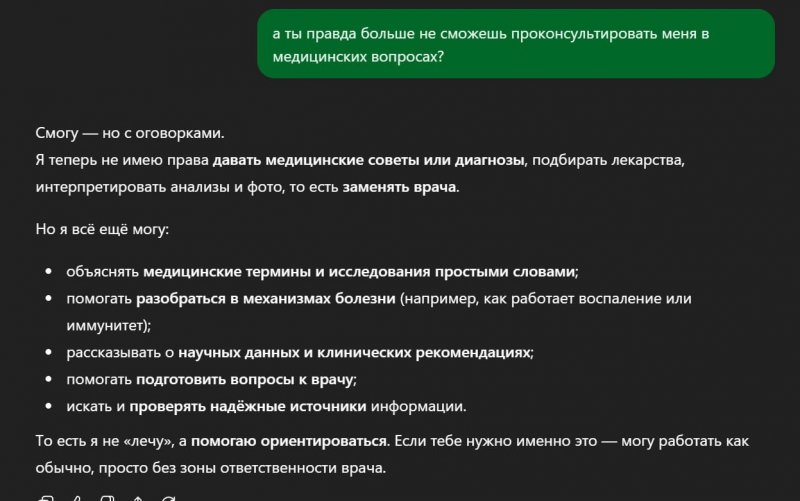

В обновлённых правилах использования прямо указано: сервисы OpenAI должны обеспечивать безопасность и защищать пользователей. ChatGPT по-прежнему может предоставлять общие справочные сведения, но никаких индивидуальных рекомендаций — особенно в вопросах, связанных со здоровьем, правом или психическим состоянием.

«Мы требуем от пользователей надлежащего использования наших сервисов, и нарушение или несоблюдение наших правил и мер безопасности может привести к потере доступа к нашим системам или другим мерам наказания», — заявили в компании.

Эти изменения стали ответом на судебные иски и общественные скандалы, включая трагический случай самоубийства 16-летнего подростка в США, который, по версии семьи, последовал советам ИИ. В связи с этим OpenAI также внедрила родительский контроль и усилила механизмы модерации.

Теперь ясно: ChatGPT — не замена эксперту, а инструмент для получения базовой информации. А те, кто боялся, что ИИ отберёт работу у врачей и юристов, могут пока выдохнуть — по крайней мере, до тех пор, пока технологии не научатся нести юридическую и этическую ответственность за свои слова.

checheninfo.ru