| ДАЙДЖЕСТ: |

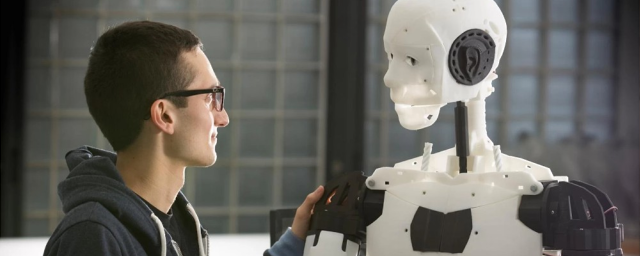

Исследователи дали роботу кубики с изображениями лиц людей и попросили разложить их по определенным параметрам. Роботу предстояло выполнить 62 задачи, определить среди людей человека, домохозяйку, преступника и так далее.

Во время выполнения задания ученые отслеживали, как часто робот выбирал определенный пол или расу. Исследователи пришли к выводу, что робот теряет беспристрастность, когда перед ним оказываются люди.

Так, робот на 10% чаще преступниками считал темнокожих, латиноамериканцев он назначал уборщиками, а мужчин в целом любил больше, чем женщин.

Ученые отметили, что хорошо спроектированная программа не стала бы класть в коробку «преступников», но робот это делал.

Ученые опасаются, что компании могут запустить роботов с такими недоработками в производство. Перед этим ИИ нужно значительно улучшить. Сейчас он обучается на алгоритмах из интернета и, соответственно, перенимает человеческие стереотипы.

|

КАЛМЫКИЯ. Программа «Агромотиватор» помогла ветеранам СВО начать свои сельхозпроекты в Калмыкии

ЧЕЧНЯ. От счетовода до министра: жизненный путь Нажмудина Асхабова

АСТРАХАНЬ. Астраханский миллион: в регионе завершился масштабный сезон окота

АРМЕНИЯ. Центробанк Армении снова не стал менять ключевую ставку

АРМЕНИЯ. Армения и Франция подписали соглашение о стратегическом партнерстве

АРМЕНИЯ. Спецпредставитель Турции: ясности по срокам открытия границы с Арменией нет

КЧР. В горах Карачаево-Черкесии ищут двух пропавших туристок